Когда я только начал работать с нейросетями в контенте, у меня был хаос. Куча инструментов, куча вкладок, куча промптов в заметках. ChatGPT для идей, Midjourney для картинок, что-то ещё для редактуры. Каждый раз — новый ритуал запуска.

Два года спустя у меня работает система, которая производит статьи, посты, скрипты для видео и карусели — стабильно, без выгорания, без постоянного изобретения велосипеда. В этой статье расскажу, как это устроено.

Почему большинство не получает результата

Проблема не в инструментах. Инструментов сейчас больше, чем нужно. Проблема в том, что люди используют нейросети как умный поиск — задал вопрос, получил ответ, скопировал. Это не система, это разовые запросы.

Разовые запросы дают разные результаты. Один раз текст получился хорошим, второй раз — посредственным, третий — опять не то. Непредсказуемо, поэтому непромышленно.

Система — это когда ты знаешь входные данные, знаешь процесс и знаешь, что получишь на выходе. Как завод: ты загружаешь сырьё, нажимаешь кнопку и на другом конце лента — готовые детали.

Чтобы получить систему, нужно сделать три вещи: зафиксировать свой голос, разбить процесс на этапы и автоматизировать переходы между ними.

Шаг 1: Зафиксируй свой голос

Первая причина, почему тексты от нейросети звучат "не как ты" — ты никогда не сказал ей, как звучит "ты".

Голос — это не стиль в вакууме. Это конкретные параметры: как длинные у тебя предложения, используешь ли ты вопросы в тексте, какие слова никогда не говоришь, к читателю на "ты" или на "вы", какой темп — быстрый или неспешный.

Я сделал файл voice-style.md — документ на несколько страниц, где записал всё это. Туда же вошли примеры хороших фрагментов из моих старых текстов и список слов-маркеров, которые я не употребляю (нет "данный", "является", "в рамках", нет стаккато из трёх коротких предложений подряд).

Этот файл загружается в каждый запрос при написании контента. Не как инструкция, которую агент читает один раз — как постоянный контекст.

Результат: тексты стали узнаваемыми. Читатели начали писать "звучит как ты, Макс" — а не "ну типичная нейросеть".

!Без voice-style vs. с voice-style: разница в тоне и результате

Если у тебя нет такого файла — это первое, что нужно сделать. Займёт час, но это инвестиция в каждый последующий текст.

Шаг 2: Разбей процесс на этапы

Ошибка, которую я видел у многих: один большой промпт — "напиши мне статью про X, 2000 слов, с примерами, SEO-оптимизированную, в моём голосе, с призывом к действию".

Нейросеть напишет. Но результат будет средним по всем параметрам и хорошим ни по одному.

Лучше работает конвейер: каждый этап — отдельная задача с конкретным фокусом.

!Конвейер от темы до готовой статьи: 5 этапов и время на каждый

Исследование. Сначала агент собирает информацию: ключевые слова, что пишут конкуренты, какие вопросы задают люди по теме. На этом этапе он не пишет — только собирает и структурирует.

Бриф. На основе исследования — короткий документ: угол статьи, главный тезис, структура разделов, 3-5 источников для цитат. Это не черновик, это план.

Черновик. Пишется по брифу. Агент знает угол, знает структуру, знает голос. На этом этапе задача одна — написать первую версию текста.

Редактура. Отдельный проход: проверка на ИИ-клише, на стаккато, на длинные тире перед союзами (у меня конкретные правила из anti-patterns файла), на технические термины без объяснений.

Audience lens. Финальная проверка: пять условных читателей из целевой аудитории читают статью и дают обратную связь. Это не реальные люди — это симуляция агентом. Но она помогает поймать места, где текст непонятен или скучен.

Каждый этап занимает меньше времени, чем "один большой промпт". И результат стабильнее.

Шаг 3: Автоматизируй переходы

Когда этапы зафиксированы, следующий шаг — убрать ручные переключения между ними.

Раньше я заканчивал исследование, копировал результаты в новый чат, вставлял туда же voice-style.md, писал промпт для черновика... Это не автоматизация, это просто переноска данных руками.

Сейчас у меня есть скилл seo-write-cc — это набор инструкций для Claude Code, который описывает весь конвейер. Я запускаю /seo:write с названием темы, и агент сам проходит через все этапы: читает voice-style.md, загружает research brief, пишет черновик, прогоняет редактуру, делает audience lens.

Человеческое участие — прочитать результат и сказать "хорошо" или "вот это переделай".

Это и есть разница между "использую нейросети" и "у меня работает система".

Реальный пример: как выглядит один цикл производства

Конкретно, чтобы не было абстракций.

Сегодня утром мне нужно было написать статью про MCP-протокол. Вот как это прошло:

- Агент запросил Notion — нашёл тему в очереди (статус "Pending", ключи: "mcp протокол, model context protocol").

- Исследование: Exa-поиск по теме, анализ трёх топовых конкурентов, сбор ключевых фактов (количество серверов, история протокола, поддерживаемые инструменты). Всё это — в research brief, один файл.

- Бриф: угол — "личный опыт, полгода использования". Структура — что такое MCP, как работает, какие серверы использую, как настроить, типичные ошибки, почему это важнее, чем кажется.

- Черновик: написан по брифу с загруженным voice-style.md. Первая версия — примерно 1000 слов.

- Редактура: прогон через anti-patterns checklist. Нашлись две фразы со стаккато, убрал. Одно длинное тире перед "И" — переписал.

- Audience lens: пять аватаров читали текст. Один сказал "непонятно, зачем создавать свой сервер, если есть 6000 готовых" — добавил объяснение.

От запуска до готового черновика — 35 минут. Руками я только читал результаты и давал уточнения.

Это не фантастика и не промо. Это работает именно так, потому что каждый элемент системы сделан один раз и работает каждый раз.

Какие нейросети для какого контента

Не все модели одинаково хороши для всех задач. Вот как это работает у меня:

Claude — основной рабочий инструмент. Длинные тексты, редактура, аналитика, работа с кодом. Лучше всего держит контекст при работе с большими документами.

Gemini — генерация изображений через API (Nano Banana на нём работает). Обложки, инфографика.

ChatGPT — иногда для второго мнения. Полезно, когда нужен другой угол на ту же тему.

Пробовать всё подряд — потеря времени. Выбери один главный инструмент, освой его глубоко, потом добавляй специализированные.

Контент-план: откуда брать темы

Система производства контента бесполезна без очереди тем. Если каждый раз придумывать с нуля — это снова хаос.

У меня очередь живёт в Notion: база с темами, ключевыми словами, приоритетами. Агент каждую неделю прогоняет её через SEO-проверку — смотрит, что ещё не написано по ключевым кластерам, добавляет новые темы.

Источники для тем: Wordstat (частотность ключевых слов), Exa (что пишут конкуренты и что набирает просмотры), Telegram-каналы аудитории (какие вопросы задают), комментарии под старыми статьями.

Хорошая тема — та, которую ищут, но которую ещё не написали лучше тебя. Не придумывай — ищи пробелы.

Что делать прямо сейчас

Если ты хочешь перейти от хаоса к системе, вот конкретный первый шаг:

Возьми свой последний текст, который тебе понравился. Открой и напиши список из 10-15 наблюдений: "здесь я пишу вот так", "здесь я никогда не использую слово X", "мои абзацы обычно вот такой длины". Это будет первая версия твоего voice-style документа.

Потом попробуй написать следующий пост с этим документом в контексте. Сравни результат с предыдущими.

Разница будет заметна уже с первого раза. А дальше — поэтапно добавляй остальные элементы системы.

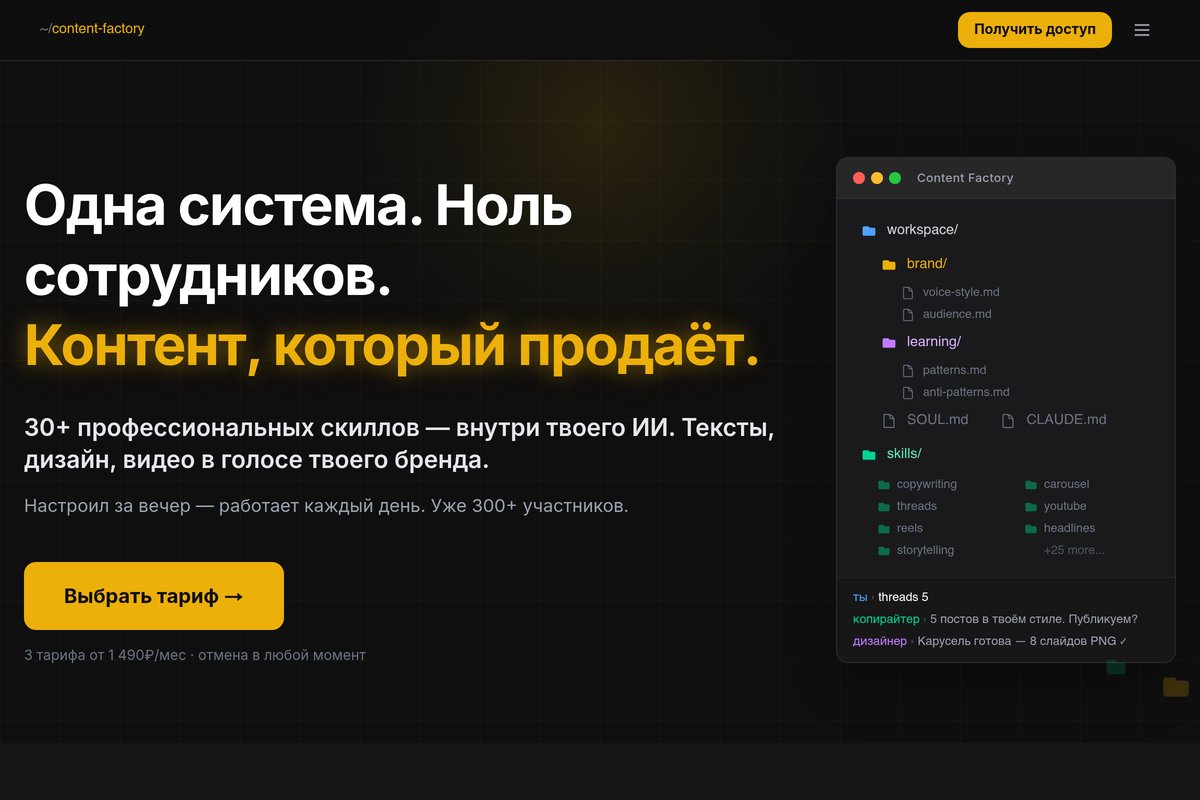

Если хочешь посмотреть на готовую систему в деле — я разбирал её подробнее в статье про Фабрику Контента. Там уже про 128 файлов и полный автономный цикл.

Одна оговорка напоследок: система не означает, что ты убираешь себя из процесса. Твой голос, твой опыт, твоя экспертиза — это то, что нейросеть не может взять ниоткуда. Агент умеет структурировать, писать чисто, не делать ошибок голоса — но "что именно сказать" приходит от тебя. Система освобождает тебя от рутины, не от творчества. Это важно не перепутать.

Люди, которые ждут, что нейросеть "сама всё напишет" — разочаровываются. Люди, которые приходят с содержанием и используют нейросеть для формы — получают результат, который раньше требовал команды.

Напиши в Telegram, на каком этапе застрял — исследование, написание или редактура. Помогу разобраться.