Два года назад вопрос был простой: «Copilot или нет?». Сейчас у разработчиков три инструмента, каждый с 80%+ на бенчмарках, и все они хотят занять одно место в стеке. Я использую все три параллельно уже три месяца. Вот что обнаружил: они не конкурируют. Они решают разные задачи — и лучшие разработчики это уже поняли.

Рыночная расстановка апреля 2026

Claude Code — 54% рынка AI coding по данным Menlo Ventures. Инструмент запустили в мае 2025, а уже через 8 месяцев обогнал Copilot и Cursor вместе взятых. «Наиболее любимый» у 46% разработчиков — против 19% у Cursor и 9% у Copilot. Cursor ответил радикально: 2 апреля 2026 запустили Cursor 3 — полный редизайн под одну идею: разработчик как оркестратор, а не исполнитель. 95% пользователей Cursor уже работают с агентами. 100% внутреннего кода самого Cursor пишут агенты. Codex (OpenAI) — ~8% рынка, но лидирует на SWE-bench-Pro: 56.8% на 1865 задач. Три игрока. Три разные архитектуры. Одна цена входа: $20/мес.

Чем они реально отличаются

Бенчмарки сбивают с толку. Claude Opus 4.6, GPT-5.3-Codex и Cursor Composer 2 все показывают ~80% на SWE-bench-Verified. Как выбирать при одинаковых числах? Вот факт, который меняет картину: Augment Code прогнал одни и те же веса через три агента на одном наборе задач. Результат: разброс от 50.2% до 55.4%. Те же веса. Тот же бенчмарк. 5-процентный разрыв — только от того, как каждый инструмент решает, что загрузить в контекст.

Второй факт: Claude Code использовал 33,000 токенов на стандартную задачу. Cursor — 188,000. В 5.7 раза больше. Это меняет логику выбора: ты выбираешь не модель. Ты выбираешь архитектуру.

Claude Code: когда нужна глубина

Terminal CLI. Философия: читает всю кодовую базу, удерживает контекст. 1M token context window по умолчанию для Max/Team/Enterprise. 135,000 коммитов в день на GitHub — 4% всех публичных коммитов. Тест на memory leak: Claude Code нашёл баг за 3 минуты и обнаружил тот же паттерн в трёх других файлах — и исправил все четыре. Cursor нашёл и исправил один.

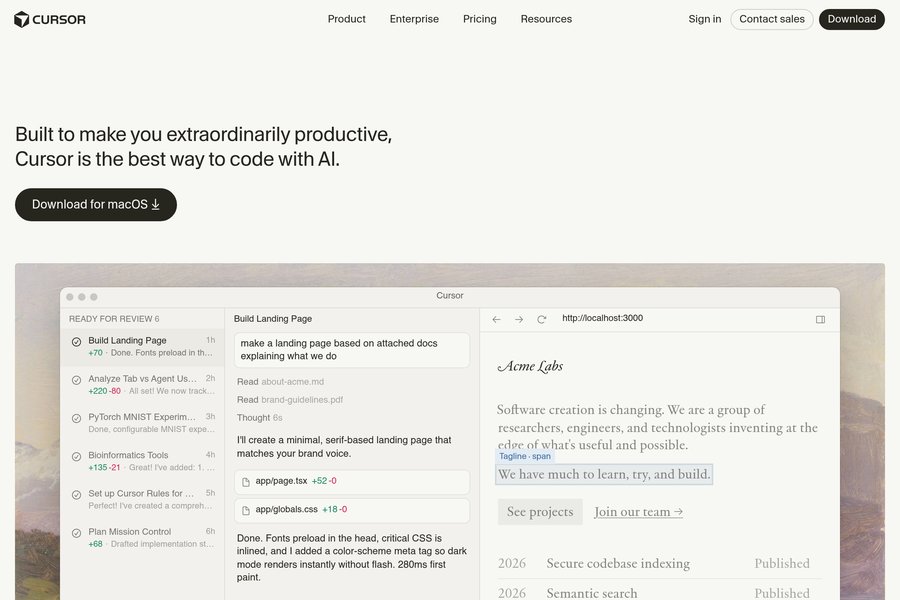

Cursor 3: когда нужна скорость

IDE на основе VS Code с Agents Window (Cmd+Shift+P) как главным экраном. Параллельные агенты — честное преимущество: на full-stack задаче Cursor выполнил её за 11 минут против 14 у Claude Code. Composer 2 (собственная модель на базе Kimi K2.5) — $0.50/M input, 86% дешевле Opus 4.6.

Codex: когда нужна автономия

Веб-дашборд + cloud sandbox. Описываешь задачу, Codex клонирует репо в изолированную VM, пишет код, запускает тесты, создаёт PR. Работает идеально для хорошо определённых изолированных задач. Провалится там, где нужно принимать решения в процессе.

Единый стек — как это работает на практике

Лучший ответ на вопрос «что выбрать» — это неправильный вопрос. Правильный: как совместить. Паттерн, который использую сам: Cursor — основной редактор (autocomplete, 72% acceptance rate, визуальная работа с UI, frontend задачи, Composer 2 как default модель). Claude Code — тяжёлые сессии (рефакторинг, дебаггинг сложных проблем, задачи где нужно понять всю кодовую базу, /effort high, 1M контекст). Codex — фоновая очередь (написать тесты, обновить документацию, стандартные операции — ставишь задачи вечером, утром смотришь PRы).

Что это значит

Год назад «выбрать AI coding tool» значило «выбрать один инструмент». Сейчас это значит «понять архитектуру каждого и распределить задачи». Это похоже на то, как мы используем разные инструменты в командной строке: grep для поиска, awk для трансформации, jq для JSON. Никто не спрашивает «что лучше — grep или awk?». Они решают разные задачи.

Момент, который кажется недооценённым: разрыв между инструментами всё меньше зависит от модели и всё больше — от архитектуры контекста. 33K vs 188K токенов на одну задачу — это не качество модели. Это качество архитектуры.